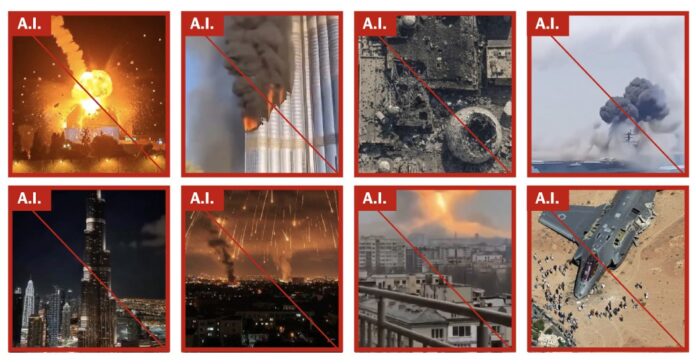

Příliv videí a obrázků generovaných umělou inteligencí (AI) zaplavil sociální média během nedávné eskalace konfliktu zahrnujícího Írán, což vyvolalo všeobecný zmatek a nedůvěru. Tyto padělky, zobrazující neexistující exploze, neexistující města pod útokem a vykonstruované přesuny jednotek, byly zhlédnuty milionykrát na X (dříve Twitter), TikTok a Facebook.

The New York Times identifikoval více než 110 unikátních kusů obsahu generovaného umělou inteligencí jen za poslední dva týdny. Falešný materiál sahá od dramatických scén Izraelců, kteří se kryjí před neexistujícími nálety v Tel Avivu, po zinscenované pohřební průvody v Íránu a dokonce i zcela fiktivní útoky na americké válečné lodě.

Proč na tom záleží: Rychlý vývoj nástrojů umělé inteligence nyní umožňuje prakticky komukoli vytvářet přesvědčivé vojenské simulace s minimálním úsilím a náklady, takže je stále obtížnější rozlišovat mezi realitou a dezinformacemi. Nejde jen o izolované incidenty; jde o systémovou zranitelnost, která podkopává důvěru v informace a potenciálně prohlubuje konflikty. Válka na Ukrajině ukázala, jak rychle lze AI využít k šíření propagandy, ale současný konflikt ukazuje ještě rychlejší šíření falešného obsahu, částečně kvůli více frontám, které jsou ve hře.

Dezinformace se změnily ve zbraně

Šíření padělků generovaných umělou inteligencí není náhodné. Odborníci ze společnosti Cyabra, která se zabývá analýzou sociálních médií, zjistili, že většina válečných videí s umělou inteligencí aktivně propaguje proíránské příběhy. Cíl: zveličovat vnímané zničení a náklady konfliktu pro Spojené státy a jejich spojence.

Jedno široce šířené falešné video zachycuje raketový útok na Tel Aviv, do kterého je záměrně zahrnuta izraelská vlajka, aby byl padělek ověřen. Nástroje AI často vkládají takové symboly, když jsou požádány o vytvoření realistických vojenských záběrů. Video bylo sdíleno na více platformách a zachytily ho okrajové zpravodajské kanály, což dokazuje, jak snadno se mohou tyto hoaxy šířit.

Zdá se, že íránská vláda tyto nástroje záměrně používá k utváření veřejného mínění. Nepravdivým zobrazováním vynikajících vojenských schopností a rozsáhlého ničení se Teherán snaží podkopat podporu pro další vojenskou akci.

Rozmazaná čára mezi skutečným a falešným

Existují autentické záběry konfliktu, které často zachytili přihlížející na mobilní telefony. I skutečná videa jsou však někdy vylepšena nástroji AI, aby se výbuchy jevily větší nebo dramatičtější, čímž se dále stírá hranice mezi autenticitou a manipulací.

Incident zahrnující U.S.S. Abraham Lincoln je toho příkladem. Poté, co íránské námořnictvo revolučních gard oznámilo úspěšný útok na letadlovou loď, zaplavily sociální sítě padělky vytvořené umělou inteligencí, které zobrazují loď v plamenech. Navzdory tvrzením USA, že útok selhal, upravené snímky vyvolaly íránské oslavy a posílily falešné příběhy.

Selhání regulace platformy

Sociální média se snaží omezit šíření válečného materiálu generovaného umělou inteligencí. Ačkoli některé platformy, jako je X, oznámily omezená opatření, jako je pozastavení monetizace pro obrázky ozbrojených konfliktů s umělou inteligencí bez řádného označení, prosazování zůstává slabé. Mnoho účtů šířících dezinformace není motivováno ziskem, ale záměrným úsilím ozbrojit narativ.

Valerie Wirtschafter, členka Brookings Institution, poznamenává: “Toto je přirozená fronta, kterou se Írán snaží využít, a zdá se, že proto je tak velká. Je to skutečně válečný nástroj.”

Klíčové shrnutí: Dezinformace generované umělou inteligencí jsou nyní nedílnou součástí moderního válčení a jsou schopné manipulovat s vnímáním veřejnosti a potenciálně eskalovat konflikty. Současná situace v Íránu ukazuje, jak snadno lze tyto nástroje vyzbrojit, a nedostatek účinné regulace naznačuje, že se tento problém bude jen zhoršovat.