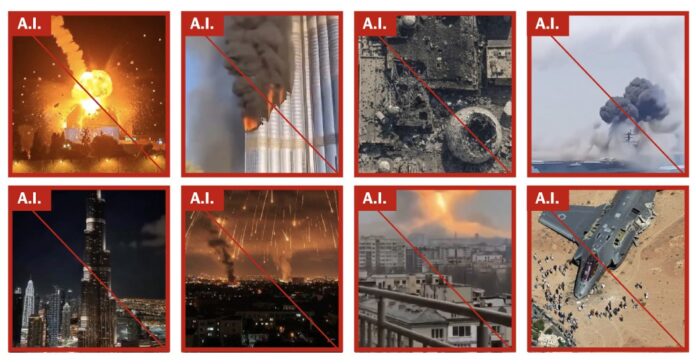

Eine Flut von mit künstlicher Intelligenz (KI) generierten Videos und Bildern hat während der jüngsten Eskalation des Iran-Konflikts die Social-Media-Plattformen überschwemmt und zu weit verbreiteter Verwirrung und Misstrauen geführt. Diese Fälschungen, die nicht existierende Explosionen, nicht existierende angegriffene Städte und erfundene Truppenbewegungen darstellen, wurden millionenfach auf X (ehemals Twitter), TikTok und Facebook angesehen.

Die New York Times hat allein in den letzten zwei Wochen über 110 einzigartige KI-generierte Inhalte identifiziert. Das fabrizierte Material reicht von dramatischen Szenen, in denen Israelis vor nicht existierenden Luftangriffen in Tel Aviv Zuflucht suchen, über inszenierte Trauer im Iran bis hin zu völlig fiktiven Angriffen auf US-Marineschiffe.

Warum das wichtig ist: Die rasante Weiterentwicklung der KI-Tools ermöglicht es mittlerweile fast jedem, mit minimalem Aufwand und Kosten überzeugende Kriegssimulationen zu erstellen, wodurch es immer schwieriger wird, zwischen Realität und Desinformation zu unterscheiden. Dabei handelt es sich nicht nur um Einzelfälle; Es handelt sich um eine systemische Schwachstelle, die das Vertrauen in Informationen untergräbt und Konflikte möglicherweise eskalieren lässt. Der Krieg in der Ukraine hat gezeigt, wie schnell KI zur Verbreitung von Propaganda eingesetzt werden kann, aber der aktuelle Konflikt zeigt eine noch schnellere Verbreitung gefälschter Inhalte, was teilweise auf die zahlreichen aktiven Fronten zurückzuführen ist.

Bewaffnete Desinformation

Die Verbreitung von KI-generierten Fälschungen ist kein Zufall. Experten von Cyabra, einem Social-Media-Intelligence-Unternehmen, fanden heraus, dass die meisten KI-Videos über den Krieg aktiv pro-iranische Narrative fördern. Der Zweck: die wahrgenommene Verwüstung und die Kosten des Konflikts für die Vereinigten Staaten und ihre Verbündeten zu übertreiben.

Ein weit verbreitetes gefälschtes Video zeigt einen Raketenangriff auf Tel Aviv, komplett mit einer absichtlich eingefügten israelischen Flagge, um die Fälschung zu authentifizieren. KI-Tools fügen solche Symbole häufig ein, wenn sie dazu aufgefordert werden, realistisch aussehende Kriegsaufnahmen zu erstellen. Das Video wurde auf mehreren Plattformen geteilt und von Randnachrichtenagenturen aufgegriffen, was zeigt, wie leicht diese Fälschungen an Bedeutung gewinnen können.

Die iranische Regierung nutzt diese Instrumente offenbar bewusst, um die öffentliche Meinung zu beeinflussen. Durch die fälschliche Darstellung überlegener militärischer Fähigkeiten und weitreichender Zerstörungen zielt Teheran darauf ab, die Unterstützung für weitere Militäraktionen zu untergraben.

Die verschwommene Grenze zwischen echt und falsch

Es gibt authentische Aufnahmen des Konflikts, die häufig von Unbeteiligten mit Mobiltelefonen aufgenommen wurden. Allerdings werden manchmal sogar echte Videos mit KI-Tools verbessert, um Explosionen größer oder dramatischer erscheinen zu lassen, wodurch die Grenze zwischen Authentizität und Manipulation weiter verwischt wird.

Die U.S.S. Der Vorfall mit Abraham Lincoln veranschaulicht dieses Chaos. Nachdem die iranische Marine der Islamischen Revolutionsgarden einen erfolgreichen Angriff auf das Flugzeugträger behauptet hatte, überschwemmte eine Flut von KI-generierten Fälschungen, die das brennende Schiff zeigten, die sozialen Medien. Trotz der Behauptungen der USA, dass der Angriff gescheitert sei, befeuerten die gefälschten Bilder die iranischen Feierlichkeiten und verstärkten falsche Narrative.

Das Scheitern der Plattformregulierung

Social-Media-Unternehmen haben Mühe, die Verbreitung von KI-generierten Kriegsinhalten einzudämmen. Während einige Plattformen wie X begrenzte Maßnahmen angekündigt haben – etwa die Aussetzung der Monetarisierung für unbeschriftete KI-Darstellungen bewaffneter Konflikte – bleibt die Durchsetzung schwach. Bei vielen Konten, die Desinformation verbreiten, geht es nicht um Profit, sondern um den bewussten Versuch, die Erzählung zu einer Waffe zu machen.

Wie Valerie Wirtschafter, Stipendiatin der Brookings Institution, feststellt: „Dies ist eine natürliche Front, die der Iran auszunutzen versucht, und es scheint, dass dies einer der Gründe dafür ist, dass sie so umfangreich ist. Es ist tatsächlich ein Kriegsinstrument.“

Das Fazit: KI-generierte Desinformation ist heute ein integraler Bestandteil der modernen Kriegsführung und kann die öffentliche Wahrnehmung manipulieren und möglicherweise Konflikte eskalieren. Die aktuelle Situation im Iran zeigt, wie leicht diese Werkzeuge als Waffe eingesetzt werden können, und der Mangel an wirksamer Regulierung lässt darauf schließen, dass sich dieses Problem nur verschlimmern wird.