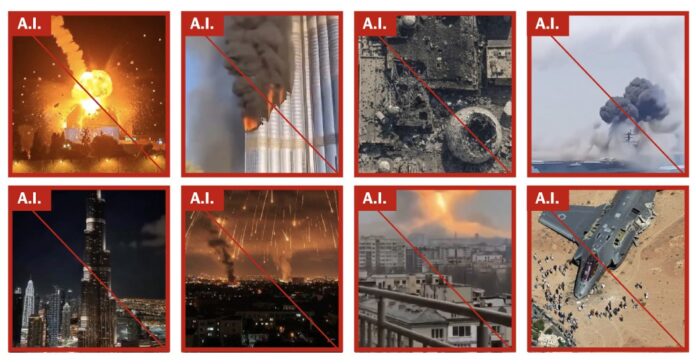

Una avalancha de videos e imágenes generados por inteligencia artificial (IA) ha abrumado las plataformas de redes sociales durante la reciente escalada del conflicto que involucra a Irán, creando confusión y desconfianza generalizadas. Estas falsificaciones, que representan explosiones inexistentes, ciudades inexistentes bajo ataque y movimientos de tropas inventados, han sido vistas millones de veces en X (anteriormente Twitter), TikTok y Facebook.

El New York Times identificó más de 110 contenidos únicos generados por IA solo en las últimas dos semanas. El material fabricado abarca desde escenas dramáticas de israelíes refugiándose de ataques aéreos inexistentes en Tel Aviv hasta duelos escenificados en Irán, e incluso ataques enteramente ficticios contra buques de guerra estadounidenses.

Por qué esto es importante: El rápido avance de las herramientas de inteligencia artificial ahora permite que casi cualquier persona cree simulaciones de guerra convincentes con un mínimo esfuerzo y costo, lo que hace cada vez más difícil distinguir entre la realidad y la desinformación. No se trata sólo de incidentes aislados; es una vulnerabilidad sistémica que socava la confianza en la información y potencialmente intensifica el conflicto. La guerra en Ucrania demostró lo rápido que se puede utilizar la IA para difundir propaganda, pero el conflicto actual muestra una proliferación aún más rápida de contenido falso, en parte debido a los múltiples frentes activos.

Desinformación armada

La proliferación de falsificaciones generadas por IA no es accidental. Los expertos de Cyabra, una empresa de inteligencia de redes sociales, descubrieron que la mayoría de los vídeos de IA sobre la guerra promueven activamente narrativas proiraníes. El propósito: exagerar la devastación percibida y el costo del conflicto para Estados Unidos y sus aliados.

Un vídeo falso que circuló ampliamente muestra un ataque con misiles contra Tel Aviv, con una bandera israelí incluida intencionalmente para autentificar la mentira. Las herramientas de inteligencia artificial a menudo insertan dichos símbolos cuando se les solicita que creen imágenes de guerra de aspecto realista. El vídeo se compartió en múltiples plataformas y fue recogido por medios de comunicación marginales, lo que demuestra la facilidad con la que estas falsificaciones pueden ganar terreno.

El gobierno iraní parece estar aprovechando deliberadamente estas herramientas para moldear la opinión pública. Al presentar falsamente capacidades militares superiores y una destrucción generalizada, Teherán pretende socavar el apoyo a la continuación de la acción militar.

La línea borrosa entre lo real y lo falso

Existen imágenes reales del conflicto, a menudo capturadas por transeúntes con teléfonos móviles. Sin embargo, incluso los vídeos reales a veces se mejoran con herramientas de inteligencia artificial para hacer que las explosiones parezcan más grandes o más dramáticas, difuminando aún más la línea entre autenticidad y manipulación.

Los EE.UU. El incidente de Abraham Lincoln ejemplifica este caos. Después de que la Armada de la Guardia Revolucionaria Islámica de Irán afirmara haber realizado un ataque exitoso contra el portaaviones, una avalancha de falsificaciones generadas por IA que mostraban el barco en llamas inundó las redes sociales. A pesar de las afirmaciones de Estados Unidos de que el ataque fracasó, las imágenes fabricadas alimentaron las celebraciones iraníes y reforzaron narrativas falsas.

El fracaso de la regulación de las plataformas

Las empresas de redes sociales han luchado por contener la difusión de contenido bélico generado por IA. Si bien algunas plataformas, como X, han anunciado medidas limitadas, como suspender la monetización de representaciones de conflictos armados no etiquetadas por IA, la aplicación sigue siendo débil. Muchas cuentas que difunden desinformación no están motivadas por ganancias sino por un esfuerzo deliberado por convertir la narrativa en un arma.

Como señala Valerie Wirtschafter, miembro de la Brookings Institution: “Este es un frente natural que Irán puede intentar explotar, y parece que esta es una de las razones por las que es tan voluminoso. En realidad, es una herramienta de guerra”.

La conclusión: La desinformación generada por la IA es ahora una parte integral de la guerra moderna, capaz de manipular la percepción pública y potencialmente escalar los conflictos. La situación actual en Irán demuestra con qué facilidad estas herramientas pueden convertirse en armas, y la falta de una regulación eficaz sugiere que este problema sólo empeorará.