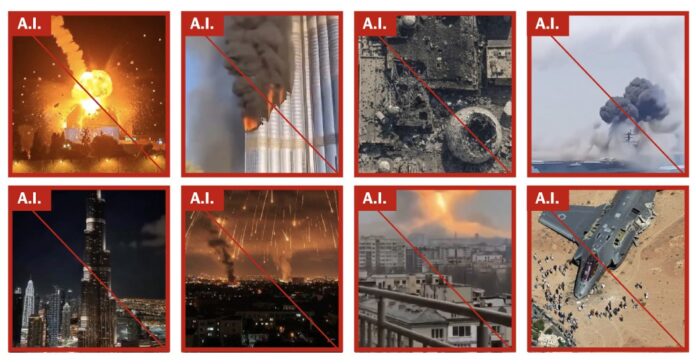

Un flot de vidéos et d’images générées par l’intelligence artificielle (IA) a submergé les plateformes de médias sociaux lors de la récente escalade du conflit impliquant l’Iran, créant une confusion et une méfiance généralisées. Ces contrefaçons, illustrant des explosions inexistantes, des villes inexistantes attaquées et des mouvements de troupes fabriqués, ont été vues des millions de fois sur X (anciennement Twitter), TikTok et Facebook.

Le New York Times a identifié plus de 110 éléments de contenu uniques générés par l’IA au cours des deux dernières semaines seulement. Le matériel fabriqué va de scènes dramatiques d’Israéliens se abritant contre des frappes aériennes inexistantes à Tel Aviv, à des mises en scène de deuil en Iran, et même à des attaques entièrement fictives contre des navires de guerre américains.

Pourquoi est-ce important : Les progrès rapides des outils d’IA permettent désormais à presque tout le monde de créer des simulations de guerre convaincantes avec un minimum d’effort et de coût, ce qui rend de plus en plus difficile la distinction entre réalité et désinformation. Il ne s’agit pas seulement d’incidents isolés ; il s’agit d’une vulnérabilité systémique qui mine la confiance dans l’information et risque d’aggraver les conflits. La guerre en Ukraine a démontré avec quelle rapidité l’IA peut être utilisée pour diffuser de la propagande, mais le conflit actuel montre une prolifération encore plus rapide des faux contenus, en partie à cause des multiples fronts actifs.

Désinformation militarisée

La prolifération des contrefaçons générées par l’IA n’est pas accidentelle. Les experts de Cyabra, une société de renseignement sur les réseaux sociaux, ont découvert que la majorité des vidéos d’IA sur la guerre promeuvent activement les récits pro-iraniens. Le but : exagérer la dévastation et le coût perçus du conflit pour les États-Unis et leurs alliés.

Une fausse vidéo largement diffusée montre une frappe de missile sur Tel Aviv, avec un drapeau israélien intentionnellement inclus pour authentifier la fabrication. Les outils d’IA insèrent souvent de tels symboles lorsqu’ils sont invités à créer des images de guerre réalistes. La vidéo a été partagée sur plusieurs plateformes et reprise par des médias marginaux, démontrant avec quelle facilité ces contrefaçons peuvent gagner du terrain.

Le gouvernement iranien semble délibérément exploiter ces outils pour façonner l’opinion publique. En présentant faussement des capacités militaires supérieures et des destructions généralisées, Téhéran vise à saper le soutien à la poursuite de l’action militaire.

La frontière floue entre le vrai et le faux

Il existe des images authentiques du conflit, souvent capturées par des passants sur leurs téléphones portables. Cependant, même les vidéos réelles sont parfois améliorées avec des outils d’IA pour rendre les explosions plus grandes ou plus dramatiques, brouillant encore davantage la frontière entre authenticité et manipulation.

L’U.S.S. L’incident d’Abraham Lincoln illustre ce chaos. Après que la marine iranienne des Gardiens de la révolution islamique a revendiqué une attaque réussie contre le porte-avions, un déluge de contrefaçons générées par l’IA montrant le navire en feu a inondé les médias sociaux. Malgré les affirmations américaines selon lesquelles l’attaque a échoué, les images fabriquées ont alimenté les célébrations iraniennes et renforcé les faux récits.

L’échec de la régulation des plateformes

Les sociétés de médias sociaux ont eu du mal à contenir la propagation du contenu de guerre généré par l’IA. Même si certaines plateformes, comme X, ont annoncé des mesures limitées – comme la suspension de la monétisation des représentations non étiquetées de conflits armés par l’IA – l’application reste faible. De nombreux comptes diffusant de la désinformation ne sont pas motivés par le profit mais par un effort délibéré visant à transformer le récit en arme.

Comme le note Valerie Wirtschafter, chercheuse à la Brookings Institution, “Il s’agit d’un front naturel que l’Iran peut essayer d’exploiter, et il semble que c’est l’une des raisons pour lesquelles il est si volumineux. C’est en fait un outil de guerre.”

En résumé : La désinformation générée par l’IA fait désormais partie intégrante de la guerre moderne, capable de manipuler la perception du public et potentiellement d’intensifier les conflits. La situation actuelle en Iran démontre avec quelle facilité ces outils peuvent être transformés en armes, et l’absence de réglementation efficace suggère que ce problème ne fera que s’aggraver.