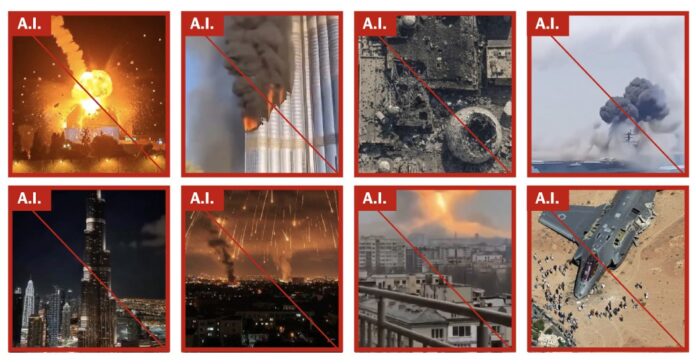

Un’ondata di video e immagini generati dall’intelligenza artificiale (AI) ha travolto le piattaforme dei social media durante la recente escalation del conflitto che ha coinvolto l’Iran, creando diffusa confusione e sfiducia. Questi falsi, raffiguranti esplosioni inesistenti, città inesistenti sotto attacco e movimenti di truppe inventati, sono stati visti milioni di volte su X (ex Twitter), TikTok e Facebook.

Il New York Times ha identificato oltre 110 contenuti unici generati dall’intelligenza artificiale solo nelle ultime due settimane. Il materiale inventato spazia da scene drammatiche di israeliani che si riparano da attacchi aerei inesistenti a Tel Aviv, a lutto inscenato in Iran, e persino attacchi del tutto fittizi contro navi militari statunitensi.

Perché è importante: Il rapido progresso degli strumenti di intelligenza artificiale consente ora quasi a chiunque di creare simulazioni di guerra convincenti con sforzi e costi minimi, rendendo sempre più difficile distinguere tra realtà e disinformazione. Non si tratta solo di incidenti isolati; è una vulnerabilità sistemica che mina la fiducia nelle informazioni e potenzialmente intensifica il conflitto. La guerra in Ucraina ha dimostrato quanto velocemente l’intelligenza artificiale possa essere utilizzata per diffondere la propaganda, ma il conflitto attuale mostra una proliferazione ancora più rapida di contenuti falsi, in parte a causa dei molteplici fronti attivi.

Disinformazione armata

La proliferazione di falsi generati dall’intelligenza artificiale non è casuale. Gli esperti di Cyabra, una società di social media intelligence, hanno scoperto che la maggior parte dei video di intelligenza artificiale sulla guerra promuovono attivamente narrazioni filo-iraniane. Lo scopo: esagerare la devastazione percepita e il costo del conflitto per gli Stati Uniti e i suoi alleati.

Un video falso ampiamente diffuso mostra un attacco missilistico su Tel Aviv, completo di una bandiera israeliana intenzionalmente inclusa per autenticare la fabbricazione. Gli strumenti di intelligenza artificiale spesso inseriscono tali simboli quando viene richiesto di creare filmati di guerra dall’aspetto realistico. Il video è stato condiviso su più piattaforme e ripreso da organi di informazione marginali, dimostrando quanto facilmente questi falsi possano guadagnare terreno.

Sembra che il governo iraniano stia deliberatamente sfruttando questi strumenti per influenzare l’opinione pubblica. Dipingendo falsamente capacità militari superiori e distruzione diffusa, Teheran mira a minare il sostegno alla continuazione dell’azione militare.

La linea sfumata tra reale e falso

Esistono filmati autentici del conflitto, spesso catturati dagli astanti sui telefoni cellulari. Tuttavia, anche i video reali a volte vengono migliorati con strumenti di intelligenza artificiale per far apparire le esplosioni più grandi o più drammatiche, offuscando ulteriormente il confine tra autenticità e manipolazione.

Gli Stati Uniti L’incidente di Abraham Lincoln esemplifica questo caos. Dopo che la Marina delle Guardie della Rivoluzione Islamica dell’Iran ha rivendicato un attacco riuscito alla portaerei, un diluvio di falsi generati dall’intelligenza artificiale che raffiguravano la nave in fiamme ha inondato i social media. Nonostante gli Stati Uniti affermino che l’attacco è fallito, le immagini fabbricate hanno alimentato le celebrazioni iraniane e rafforzato le false narrazioni.

Il fallimento della regolamentazione delle piattaforme

Le società di social media hanno lottato per contenere la diffusione di contenuti di guerra generati dall’intelligenza artificiale. Sebbene alcune piattaforme, come X, abbiano annunciato misure limitate – come la sospensione della monetizzazione per rappresentazioni di conflitti armati basate sull’intelligenza artificiale senza etichetta – l’applicazione rimane debole. Molti resoconti che diffondono disinformazione non sono motivati dal profitto ma da uno sforzo deliberato di trasformare la narrazione in un’arma.

Come osserva Valerie Wirtschafter, ricercatrice della Brookings Institution, “Questo è un fronte naturale che l’Iran cerca di sfruttare, e sembra che questo sia uno dei motivi per cui è così voluminoso. In realtà è uno strumento di guerra”.

Il punto è: la disinformazione generata dall’intelligenza artificiale è ormai parte integrante della guerra moderna, in grado di manipolare la percezione pubblica e potenzialmente intensificare i conflitti. L’attuale situazione in Iran dimostra quanto facilmente questi strumenti possano essere utilizzati come armi, e la mancanza di una regolamentazione efficace suggerisce che questo problema non potrà che peggiorare.