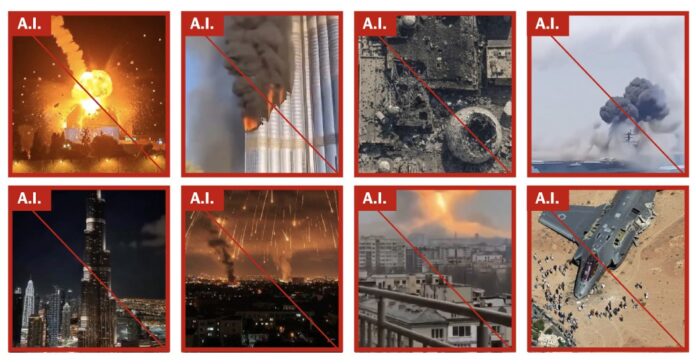

Een stroom van door kunstmatige intelligentie (AI) gegenereerde video’s en afbeeldingen heeft de sociale-mediaplatforms overweldigd tijdens de recente escalatie van het conflict waarbij Iran betrokken was, waardoor wijdverbreide verwarring en wantrouwen ontstond. Deze vervalsingen, die niet-bestaande explosies, niet-bestaande steden die worden aangevallen en verzonnen troepenbewegingen weergeven, zijn miljoenen keren bekeken op X (voorheen Twitter), TikTok en Facebook.

Alleen al in de afgelopen twee weken heeft de New York Times meer dan 110 unieke, door AI gegenereerde stukjes content geïdentificeerd. Het verzonnen materiaal varieert van dramatische scènes van Israëliërs die zich schuilhouden voor niet-bestaande luchtaanvallen in Tel Aviv tot geënsceneerde rouw in Iran, en zelfs geheel fictieve aanvallen op Amerikaanse marineschepen.

Waarom dit belangrijk is: Dankzij de snelle ontwikkeling van AI-tools kan bijna iedereen overtuigende oorlogssimulaties maken met minimale inspanning en kosten, waardoor het steeds moeilijker wordt om onderscheid te maken tussen realiteit en desinformatie. Dit gaat niet alleen over geïsoleerde incidenten; het is een systemische kwetsbaarheid die het vertrouwen in informatie ondermijnt en conflicten potentieel doet escaleren. De oorlog in Oekraïne heeft laten zien hoe snel AI kan worden gebruikt om propaganda te verspreiden, maar het huidige conflict laat een nog snellere proliferatie van nep-inhoud zien, mede dankzij de meerdere actieve fronten.

Bewapende desinformatie

De verspreiding van door AI gegenereerde namaakproducten is niet toevallig. Deskundigen van Cyabra, een bedrijf voor sociale media-inlichtingen, ontdekten dat de meerderheid van de AI-video’s over de oorlog actief pro-Iraanse verhalen promoot. Het doel: de waargenomen verwoesting en de kosten van het conflict voor de Verenigde Staten en hun bondgenoten overdrijven.

Eén wijdverspreide nepvideo toont een raketaanval op Tel Aviv, compleet met een Israëlische vlag die opzettelijk is toegevoegd om de verzinsel te authenticeren. AI-tools zullen dergelijke symbolen vaak invoegen wanneer daarom wordt gevraagd om realistisch ogende oorlogsbeelden te maken. De video werd op meerdere platforms gedeeld en opgepikt door marginale nieuwskanalen, wat aantoont hoe gemakkelijk deze vervalsingen grip kunnen krijgen.

De Iraanse regering lijkt bewust gebruik te maken van deze instrumenten om de publieke opinie te vormen. Door ten onrechte superieure militaire capaciteiten en wijdverbreide vernietiging af te schilderen, wil Teheran de steun voor voortgezette militaire actie ondermijnen.

De vage grens tussen echt en nep

Er bestaan echte beelden van het conflict, vaak vastgelegd door omstanders op mobiele telefoons. Maar zelfs echte video’s worden soms verbeterd met AI-tools om explosies groter of dramatischer te laten lijken, waardoor de grens tussen authenticiteit en manipulatie verder vervaagt.

De U.S.S. Het incident met Abraham Lincoln is een voorbeeld van deze chaos. Nadat de Iraanse Islamitische Revolutionaire Garde een succesvolle aanval op het vliegdekschip had opgeëist, overspoelde een stortvloed aan AI-gegenereerde vervalsingen die het schip in brand afbeeldden de sociale media. Ondanks Amerikaanse beweringen dat de aanval mislukte, voedden de verzonnen beelden Iraanse vieringen en versterkten ze valse verhalen.

Het falen van platformregulering

Socialemediabedrijven hebben moeite om de verspreiding van door AI gegenereerde oorlogsinhoud in te dammen. Hoewel sommige platforms, zoals X, beperkte maatregelen hebben aangekondigd – zoals het opschorten van het genereren van inkomsten voor ongelabelde AI-afbeeldingen van gewapende conflicten – blijft de handhaving zwak. Veel accounts die desinformatie verspreiden, zijn niet gemotiveerd door winstbejag, maar door een doelbewuste poging om het verhaal te bewapenen.

Zoals Valerie Wirtschafter, een collega bij het Brookings Institution, opmerkt: “Dit is een natuurlijk front voor Iran om te proberen uit te buiten, en het voelt alsof dit een van de redenen is waarom het zo omvangrijk is. Het is eigenlijk een oorlogsinstrument.”

Waar het op neerkomt: Door AI gegenereerde desinformatie is nu een integraal onderdeel van de moderne oorlogsvoering en is in staat de publieke perceptie te manipuleren en mogelijk conflicten te escaleren. De huidige situatie in Iran laat zien hoe gemakkelijk deze instrumenten kunnen worden bewapend, en het gebrek aan effectieve regelgeving suggereert dat dit probleem alleen maar zal verergeren.