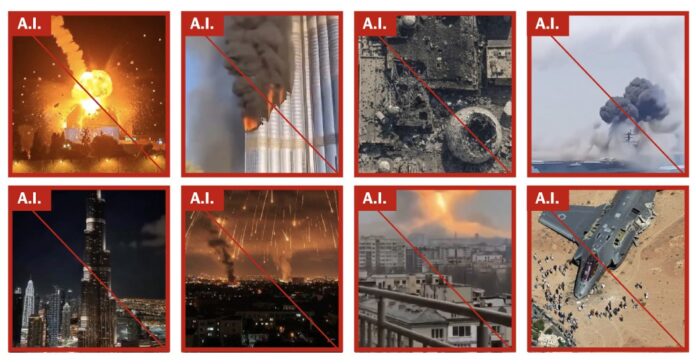

Podczas niedawnej eskalacji konfliktu z udziałem Iranu media społecznościowe zalały napływ filmów i zdjęć generowanych przez sztuczną inteligencję (AI), wywołując powszechne zamieszanie i brak zaufania. Te podróbki, przedstawiające nieistniejące eksplozje, atakowane nieistniejące miasta i sfabrykowane ruchy wojsk, były oglądane miliony razy na X (dawniej Twitterze), TikToku i Facebooku.

Tylko w ciągu ostatnich dwóch tygodni dziennik New York Times zidentyfikował ponad 110 unikalnych treści generowanych przez sztuczną inteligencję. Fałszywe materiały obejmują dramatyczne sceny ukrywania się Izraelczyków przed nieistniejącymi nalotami w Tel Awiwie, inscenizowane procesje pogrzebowe w Iranie, a nawet całkowicie fikcyjne ataki na amerykańskie okręty wojenne.

Dlaczego to ma znaczenie: szybki rozwój narzędzi sztucznej inteligencji pozwala obecnie praktycznie każdemu tworzyć przekonujące symulacje wojskowe przy minimalnym wysiłku i kosztach, co sprawia, że coraz trudniej jest odróżnić rzeczywistość od dezinformacji. Nie chodzi tylko o pojedyncze przypadki; jest to luka systemowa, która podważa zaufanie do informacji i potencjalnie zaostrza konflikt. Wojna na Ukrainie pokazała, jak szybko można wykorzystać sztuczną inteligencję do szerzenia propagandy, ale obecny konflikt pokazuje jeszcze szybsze rozprzestrzenianie się fałszywych treści, częściowo ze względu na działanie wielu frontów.

Dezinformacja zamieniona w broń

Rozpowszechnianie podróbek generowanych przez sztuczną inteligencję nie jest przypadkowe. Eksperci z Cyabra, firmy zajmującej się analizą mediów społecznościowych, odkryli, że większość filmów wojennych opartych na sztucznej inteligencji aktywnie promuje narracje proirańskie. Cel: wyolbrzymić postrzegane zniszczenia i koszty konfliktu dla Stanów Zjednoczonych i ich sojuszników.

Jeden z szeroko rozpowszechnianych fałszywych filmów przedstawia atak rakietowy na Tel Awiw, na którym celowo umieszczono izraelską flagę w celu potwierdzenia autentyczności fałszywki. Narzędzia AI często wstawiają takie symbole, gdy są proszone o utworzenie realistycznego materiału wojskowego. Film został udostępniony na wielu platformach i odebrany przez poboczne serwisy informacyjne, co pokazało, jak łatwo mogą rozprzestrzeniać się te oszustwa.

Wydaje się, że rząd irański celowo wykorzystuje te narzędzia do kształtowania opinii publicznej. Fałszywie przedstawiając doskonałe zdolności wojskowe i powszechne zniszczenia, Teheran stara się podważyć poparcie dla dalszych działań wojskowych.

Zamazana linia między prawdą a fałszem

Istnieje autentyczny materiał filmowy z konfliktu, często rejestrowany przez osoby postronne na telefonach komórkowych. Jednak nawet prawdziwe filmy są czasami wzbogacane narzędziami sztucznej inteligencji, dzięki czemu eksplozje wydają się większe lub bardziej dramatyczne, co jeszcze bardziej zaciera granicę między autentycznością a manipulacją.

Incydent z udziałem U.S.S. Przykładem tego jest Abraham Lincoln. Po tym, jak irańska marynarka wojenna Gwardii Rewolucyjnej ogłosiła udany atak na lotniskowiec, media społecznościowe zostały zalane fałszywymi generowanymi przez sztuczną inteligencję, przedstawiającymi płonący statek. Pomimo twierdzeń Stanów Zjednoczonych, że atak się nie powiódł, sfałszowane zdjęcia wywołały w Iranie uroczystości i wzmocniły fałszywe narracje.

Awaria regulacji platformy

Media społecznościowe usilnie starają się ograniczyć rozprzestrzenianie się materiałów wojennych generowanych przez sztuczną inteligencję. Chociaż niektóre platformy, takie jak X, ogłosiły ograniczone środki, takie jak zawieszenie monetyzacji obrazów konfliktów zbrojnych przedstawiających sztuczną inteligencję bez odpowiedniego oznakowania, egzekwowanie prawa pozostaje słabe. Motywacją wielu kont szerzących dezinformację nie jest zysk, ale celowe wysiłki mające na celu uzbrojenie narracji.

Jak zauważa Valerie Wirtschafter, pracownik Brookings Institution: „To naturalny front, który Iran może próbować wykorzystać, i wydaje się, że właśnie dlatego jest taki duży. To naprawdę narzędzie wojny”.

Kluczowy wniosek: dezinformacja generowana przez sztuczną inteligencję jest obecnie integralną częścią współczesnych działań wojennych, zdolną do manipulowania odbiorem publicznym i potencjalnie eskalacji konfliktów. Obecna sytuacja w Iranie pokazuje, jak łatwo można te narzędzia wykorzystać jako broń, a brak skutecznych regulacji sugeruje, że problem ten będzie się tylko pogłębiał.